Dabei ist natürlich, dass diese Infos immer topaktuell sind, das Autohirn muss immer gleich wissen, wenn sich etwas auf dem Weg ändert, ein Unfall, eine Baustelle, ein neues Tempolimit. Denn solche Aspekte betreffen die Sicherheit, und die ist eine der entscheidenden Faktoren bei der Entwicklung automatisierter Autos ist. Nur wenn die Menschen sich sicher fühlen, werden sie in Zukunft in ein automatisch fahrendes Auto steigen und die Kontrolle darüber abgeben.

„Unfallzahlen für SDCs werden sich Richtung Null bewegen,“ schreibt Egil Juliussen in der Studie Autonomous Cars der Analysefirma IHS. Noch gibt es pro Jahr weltweit 1.2 Millionen Unfalltote. Über 90 Prozent der Autounfälle sind dabei auf menschliches Versagen zurückzuführen, berichtet die International Organisation for Road Accident Prevention (Internationale Organisation zur Unfallprävention im Straßenverkehr). Der größte Risikofaktor im Straßenverkehr ist der Mensch. Der Autojournalist Tom Vanderbilt hat herausgefunden, dass wir bei einer Geschwindigkeit von knapp 50 km/h durchschnittlich 1320 Informationen pro Minute verarbeiten müssen. Unsere Wahrnehmung dafür aber sinkt, sobald wir das Radio anschalten, Telefonieren, Nachrichten tippen, weil wir gelangweilt die Gedanken schweifen lassen, übermüdet sind. Und: Weil wir zu viel Bier getrunken haben. Von 32 000 tödlichen Unfällen im Jahr in den USA werden über 60 Prozent durch Alkoholeinfluss des Fahrers und Geschwindigkeitsüberschreitung verursacht (Eno Center for Transportation).

Und da liegt der Knackpunkt: Eine Maschine trinkt nicht und ihr wird auch nicht nach 250 Kilometern öder Autobahnfahrt langweilig. Das wird den entscheidenden Ausschlag für die Verbreitung von Autopilot-Auto geben, so Juliussen weiter. Wegen des hohen Sicherheitsfaktors werde ihre Zahl daher in nur 15 Jahren weltweit auf 54 Millionen im Jahr 2035 ansteigen. Und dennoch: Das Vertrauen in die neue Technik ist nicht ohne Risiko.

Software vs. Sicherheit

In einem Autopilot-Auto zu sitzen ist vergleichbar mit einem Piloten in einem Flugzeug. Die Hauptstrecke lässt dieser per Autopilot fliegen. Es ist einfacher und sicherer als wenn der Pilot alles selbst machen würde. Doch Software kann Fehler machen. Beim Unfall des Militärtransporters Airbus A400M hatte die Software die Triebwerke nach dem Start abgeschaltet. Die Piloten erkannten das Problem: Sie wollten, aber konnten keinen Einfluss mehr auf die (Computer-)Steuerung ihrer Maschine nehmen. Der A400M stürzte ab, vier Menschen starben. Eine Analyse ergab, dass das System einen zuvor menschlichen Fehler nicht angezeigt hatte. Bleibt der Datenaustausch zwischen Kommunikationsknotenpunkten und einem Autopilot-Auto aus, crasht das Auto womöglich mit 130 km/h in ein Stauende, statt es abzubremsen.

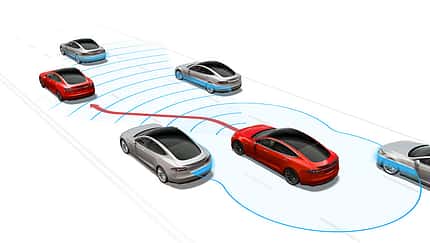

Noch dramatischere Auswirkungen werden Sicherheitslücken in der Software der Autos haben, warnen Experten. Schon jetzt gelingt es Hackern sich Zugang zu den Systemen heutiger Automodelle zu verschaffen: Sie können die Steuerung übernehmen, den Motor ausschalten und die Geschwindigkeit beeinflussen. Autopilot-Auto sollen nach Plänen der US-Bundesbehörde für Straßen- und Fahrzeugsicherheit (NHTSA) aber nicht nur mit ihrer Umgebung kommunizieren, sondern auch untereinander. Dabei müssen die Hersteller also einerseits ein Verfahren finden, dass sichere Software garantiert; und anderseits ein System entwickeln, dass die Privatsphäre Hundertmillionen neuer Autodaten schützt. Im schlimmsten Fall könnten beispielsweise Terroristen ansonsten einen laxen Umgang mit beiden Sicherheitsherausforderungen ausnutzen und Fehlermeldungen wie ein Computervirus auf hunderte Fahrzeuge gleichzeitig übertragen – und so Massen-Crashs auslösen. Die Zahl denkbarer krimineller Maschen dürfte auch nicht gerade gering sein.